ニューラルネットが導き出した「とんでもない結論」:既に始まっているコンピュータによる意思決定(後編)

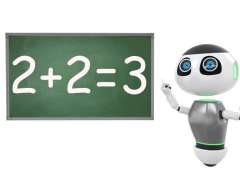

機械学習やAIによる「自動意思決定」に期待がかかるが、そこには人間による偏り(バイアス)が入り込む余地があることに注意する必要がある。あるニューラルネットは、学習の結果驚くべき結論を導き出してしまった。

前編(Computer Weekly日本語版 2017年12月20日号掲載)では、コンピュータが算出したスコアを基に量刑が決まった裁判から、その妥当性やアルゴリズムの透明性が問題になっている現状を紹介した。

後編では、学習データに入り込む偏りの問題の解決策を検討する。

データ駆動型の意思決定に潜む偏り

認知科学者のジョアンナ・ブライソン氏は、データ駆動型の意思決定における「偏り」についての研究を進めて、主に3つの対処法があると考えている。

第1の方法は、偏りがあると認識することだ。「機械学習が順調に稼働している理由は、人間の文化を活用しているからだ。善意も悪意も同時に学んでいる」と同氏は説明する。これは特に、数十年間にわたる意思決定に関するデータに影響を与える可能性がある。しかし、だからといって最近のデータだけを使用すると不規則性の偏りが助長される。

第2の方法は、民族性、場所、年齢、性別など、偏ることが明白な領域で偏り具合をテストすることだ。この方法はおのずと、IT部門で働く人の多様化につながる可能性がある。人は、自分自身に対する影響を考える傾向が強まるからだ。ただしブライソン氏は、必ずしもそうなるとは限らないと断った上で、次のように注意を促す。「かつてプログラマーだった女性という立場から言うと、それぞれの現場で支配的なグループに吸収されてしまうことが少なくない」

第3の方策として、データやアルゴリズムを利用する人々は、監査や監視に慣れなければならないとブライソン氏は指摘する。

ぜんそくにかかると肺炎で死ぬ確率が下がる?

1990年代、当時カーネギーメロン大学の大学院生だったリッチ・カルアナ氏は、ニューラルネットの機械学習システムのトレーニングに携わって、肺炎患者の死亡率を予測した。

パラレルルールをベースとしたこのモデルは、驚くべきルールを導き出した。

*** 一部省略されたコンテンツがあります。PC版でご覧ください。 ***

関連記事

「AIは物理学を理解するのではない。パターンを理解する」が持つ重大な意味

人材採用プロセスに取り込まれるAIのメリットと恐るべきリスク

米国にまん延する「AIでセキュリティの課題は解決」論の危険性

Copyright © ITmedia, Inc. All Rights Reserved.