特集/連載

主要クラウドが提供する「GPUインスタンス」、本気を引き出す高負荷アプリとは?:AWS、Azure、Googleなどがサポート

AWS、Azure、Googleなどのパブリッククラウドは、高性能なコンピューティングリソースを集中的に提供する「GPUインスタンス」を用意している。そのメリットを享受できるアプリとは?

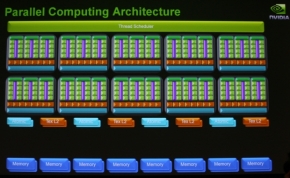

大手クラウドプロバイダーは、市場シェアの争奪戦を繰り広げながら提供するクラウドインスタンスの種類を拡大してきた。その流れの1つとして、ユーザーは、GPU(グラフィックスプロセッシングユニット)にアクセス可能なインスタンスをデプロイできるようになった。これは、特にAI(人工知能)などコンピューティングリソースを集中的に使用するワークロードにメリットがある。

今、大手クラウドプロバイダーによるGPUインスタンスを巡る競争がヒートアップし始めている。Microsoftの「Microsoft Azure」は、2016年12月にNVIDIAのGPUを搭載した「Nシリーズ」の仮想マシンを公開している。Amazonも、2016年9月に「Amazon EC2 (Elastic Cloud Compute) P2」インスタンスの新しい種類を公開したが、これにもNVIDIAのGPUを組み込んでいる。Googleでは、2017年2月に「Google Compute Engine」と「Cloud Machine Learning」でNVIDIAのGPUインスタンスをサポートすると発表している。

このようなGPUインスタンスをデプロイする前に、GPUインスタンスを使用するのが最適なアプリケーションとワークロードの種類を理解することが重要だ。このようなワークロードには、次のようなものがある。

併せて読みたいお薦め記事

利用場面が拡大するGPUコンピューティング

- 徹底解説:GPUコンピューティングが急成長する理由と減速する懸念

- GPUがけん引する“ハード黄金時代”、ディープラーニングやAI処理で需要高まる

- 仮想デスクトップ管理者のための「vGPUテクノロジー入門」

Copyright © ITmedia, Inc. All Rights Reserved.