バイセル、NEC、デジタル庁が明かす「AI活用」の舞台裏 GoogleのAIを選んだ決め手とは?:一筋縄ではいかないAI実装

AIの社会実装は着実に進んでおり、各社は成果の最大化を目指して試行錯誤を重ねている。バイセル、NEC、デジタル庁のAI活用事例を、現場の課題や工夫を交えて紹介する。

生成AI(人工知能)技術やそのベースとなる大規模言語モデル(LLM)の社会実装が着実に進んでいる。企業は独自のニーズに応じたユースケースを模索しており、幅広い分野での応用が期待される。

Googleのクラウドサービス部門Google Cloudが2024年10月24日に開催したイベント「Generative AI Summit Tokyo ‘24」では、AI関連の取り組みについて、各組織が実装の課題や工夫を交えて発表した。本稿は、リユース事業大手のBuysell Technologies(以下、Buysell)、NEC、デジタル庁の事例を紹介する。

リユース大手バイセルの“3つの事例”から学ぶAI実装のヒント

出張訪問買い取りを中心にリユース事業を展開するBuysellは、全業務領域においてAI技術への投資を進めるとしている。取締役CTO(最高技術責任者)として全社技術戦略を指揮する今村雅幸氏は、具体的なAI活用事例を3つ紹介した。

1つ目が、AI技術を用いた査定システムの内製開発だ。服飾品や酒類のブランド、商品状態、真贋を、商品画像から判定する。商品画像データとラベルデータをAI開発サービス「Vertex AI」に教師データとして読み込ませ、作成したモデルをVertex AIのエンドポイントから利用できるようにした。システムの導入後、査定時間の7割以上を削減することに成功。従来、酒類の査定に平均93秒かかっていたところを、22秒に短縮した。

2つ目が、切手のAI仕分けシステムだ。従来、切手の集計作業では紙の集計表を表計算ツール「Microsoft Excel」に手動で転記していたため、誤入力が少なくなかった。GoogleのLLM「Gemini 1.5 Pro」が集計表を光学文字認識(OCR)で読み取り、表計算ツール「Google Sheets」(Googleスプレッドシート)に出力して自動集計することで、ミスを最低限に抑える運用を実現した(図1)。Googleスプレッドシートへの出力については、正確性を高めるためにプログラミング言語「Go」で開発したアプリケーションを実装した。集計の精度は99%以上を達成しており、数字については100%の認識結果を出しているという。

今村氏は、「デジタル面とアナログ面両方からの改善が精度向上に貢献した」と話す。例えばデジタル面では、空欄や文字、記号を許容しないようにモデルをチューニングしたり、自動計算が可能な箇所は読み取らずにスプレッドシートに出力したりした。アナログ面では、OCRの精度を高めるために紙の集計表のサイズとフォーマットを変更したり、ボールペンの太さを変えたりした。

3つ目の事例が、従業員向けナレッジ検索システム「Buysell Buddy」の内製開発だ。Buysellでは、日々全国の店舗から接客や査定に関する問い合わせが届く。各種マニュアルに関連する質問に自動で回答できるよう、「RAG」(検索拡張生成)の仕組みを構築した。RAGとは、学習データ以外の外部データベースから情報を検索、取得し、LLMが事前学習していない情報も回答できるよう補う手法を指す。

具体的には、社内に散っているマニュアルやドキュメントをエンベディング(注1)し、その情報を基にGeminiが回答する仕組みだ。細かい問い合わせにも9割以上はRAGで回答を得ることができたという。2024年10月時点で50%以上の従業員が利用している。

※注1 あらゆる形式のデータを、数値のリストや配列であるベクトル形式に変換してコンピュータが処理できるようにすること

Geminiの評価ポイントとして、今村氏は以下3点を挙げる。

- Gemini 1.5 Proは200万トークンまで入力可能で、その文脈や内容を損なわずに記憶できる。

- トークンとはテキストデータを処理する際の基本的な単位で、英語であれば1トークンは4文字程度と考えられる。

- モデルの使い分けがスムーズにできる。例えば、高い精度が求められる処理にはGemini 1.5 Proを使い、他の処理には軽量かつ低コストの「Gemini Flash」を使うなど。

- マルチモーダル性に優れ、100ページ越えのPDFを扱ったり、PDF内の画像の解釈をしたりできる。

今村氏はAI導入の成功ポイントとして、「生成AIをいきなり業務全体に導入しないこと」を挙げる。まずは既存の業務を細分化して、実現性の高い部分から生成AIに置き換えることが効果創出につながりやすい。加えて、生成AIの回答精度を向上させるためには、データを時系列やツリー構造などに体系立ててからエンベディングすることが重要だと同氏は話す。

NECが全社向け検索システム導入 なぜ「Vertex AI Search」を選んだ?

2024年5月、NECは同社の全従業員約12万人向けに、社内版AIチャットbot「NEC Generative AI Service」(NGS)を提供開始した。ユーザーは複数のLLMから最適なモデルを選ぶことができ、同社が開発したLLM「Cotomi」の他、OpenAIの「GPT」やAnthropicの「Claude」、Geminiなどが選択肢に含まれる。NGSではRAGの仕組みを一部採用しており、社内向けポータルサイト「OneNEC.com」に格納された人事や業務関連のコンテンツ約12万件を検索できる(図2)。

当初、NECはオープンソースの検索サービス「Elasticsearch」をNGSの検索機能として利用していた。Elasticsearchでは緻密なアクセス権限の実装が可能であったものの、コンテンツや利用者数の増加に伴い、検索速度の低下が課題になった。「CMSを経由して検索サービスを呼び出すという構造上の問題が大きかった」と、NECで生成AI活用促進を指揮する梶野 晋氏は話す。この問題を解決するために、Amazon Web Services(AWS)の検索サービス「Amazon Kendra」に移行。検索速度は改善したものの、日本語のコンテンツに対する細やかなチューニングが難しく、期待する精度が出なかったという。

上述の課題をクリアしたのが、Googleの検索サービス「Vertex AI Search」だった。同音異義語の誤変換や表記の揺れを認識して修正してくれることや、右クリック検索機能などの拡張機能を利用できることといった、ユーザーの検索体験向上を図れる点を評価した。

NGSでは約12万件と大規模なデータを扱う。Vertex AI Searchが一度に作成できるインデックス(検索用のデータリスト)の上限は10万件だ。超過分についてインデックスへの追加はできるが、一度作成したインデックスからデータの削除はできないという制約がある。この問題については、システム利用が少ない週末の時間帯に、インデックスの再作成をする方法で対処しているという。

デジタル庁はマルチモーダルLLM「Gemini」をどう活用?

デジタル庁は、ガバメントクラウドの利用ガイドを掲載したWebサイト「GCASガイド」を2022年12月から提供している。ガバメントクラウドとは、政府や自治体など行政分野におけるデジタル施策推進のための共通のクラウドサービス利用環境を指す。

GCASガイドでは、クラウドサービスプロバイダーごとに20〜30個のドキュメントを提供している。文書内にはテキスト検索機能があり、現行の検索システムでは、ライブラリ「Fuse.js」を利用したオンメモリ(注2)の全文検索を採用しているが、以下3つの課題があった。

- 表記揺れ検索やあいまい検索ができない

- 特定の単語やフレーズの異なる表記、誤入力について考慮した検索ができない。例えば、「GCP」(Google Cloud Platformの略語)と検索してもGoogle Cloud Platform関連の情報が出てこない。

- OR検索のみ可能で、AND検索ができない

- メモリの消費が激しい

- 検索インデックスを全てメモリに保持するため、Webブラウザのメモリ消費量が負担となった。加えて、GCASガイドには日々文書が追加されているので、今後の運用が難しかった。

※注2 データをストレージではなくメモリ上に格納して処理する方式。検索時にストレージへのアクセスが不要になり、高速な検索が可能になる。

上述の課題を解決し、生成AIを用いたユーザーの検索体験向上を目指すために、デジタル庁はVertex AI Searchへの移行と、Gemini1.5 Proの活用を決断した。ユーザーが質問や検索キーワードを入力すると、該当するデータソースを検索し、Geminiが検索結果と要約文を生成して返す仕組みだ。「2024年10月時点で基本機能の開発は完了しており、検索結果の精度検証段階だ」とデジタル庁のクラウドエンジニア藤田泰介氏は話す。

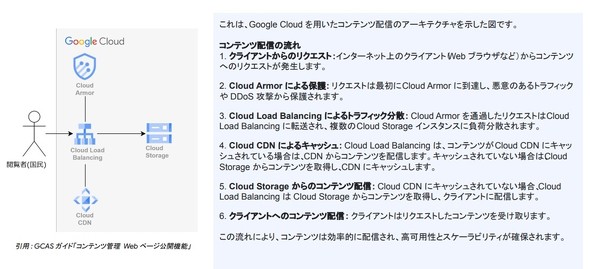

マルチモーダルLLMであるGemini1.5 Proを活用することで、画像データの活用も可能になった。GCASガイド内にはアーキテクチャ図など画像が多用されている。Gemini1.5 Proを用いて、画像の説明文テキストを生成し(図3)、ストレージサービス「Google Cloud Storage」上のMarkdownテキスト内に挿入する。その内容をVertex AI Searchを用いてインデックス化し、データストアおよび検索エンジンを作成する。検証では、画像を確認しなければ回答が難しい質問への回答や要約ができた。画像でサービス名が部分的に隠れてしまっていても、補完して説明することができたという。

GCASガイドのテキスト検索機能をサービスとして提供するため、検索精度の定量化を目指し、RAGの性能を計測するフレームワーク「RAGAS」の評価指標を用いて検索精度を測定している最中だと藤田氏は説明する。精度検証には、検索クエリと正解のデータセットが必要だ。品質面の観点から、検証用のデータセットは人間が作成することが望ましいが、時間と手間がかかる。そのため初期の検証では、GeminiとRAGAS で生成した合成データを一時的に使用しつつ、継続的インテグレーション/継続的デリバリー(CI/CD)パイプラインなど精度検証の仕組みを構築。その間に本番用の検証用のデータセットを作成したという。

Copyright © ITmedia, Inc. All Rights Reserved.