KubernetesƒNƒ‰ƒXƒ^‚جپgPodٹش’تگMپh‚جٹî–{پ@پu3‚آ‚جServiceپv‚ح‚ب‚؛•K—v‚©پHپFƒRƒ“ƒeƒiƒlƒbƒgƒڈپ[ƒN‚جٹî‘b’mژ¯پy‘و8‰ٌپz

KubernetesƒNƒ‰ƒXƒ^‚ج“®چى‚ة‚حPodٹش‚إ’تگM‚·‚邽‚ك‚جژd‘g‚ف‚ھ•K—v‚إ‚·پBپuClusterIPپvپuNodePortپvپuLoadBalancerپv‚ج3‚آ‚جپuServiceپv‚جژd‘g‚ف‚ً‚»‚ꂼ‚êڈذ‰î‚µ‚ـ‚·پB

پ@ƒRƒ“ƒeƒiƒIپ[ƒPƒXƒgƒŒپ[ƒ^پ[پuKubernetesپv‚إ‚ح•،گ”‚جƒRƒ“ƒeƒiژہچsƒzƒXƒg‚ھƒNƒ‰ƒXƒ^پiˆب‰؛پAKubernetesƒNƒ‰ƒXƒ^پj‚ًچ\گ¬‚µ‚ـ‚·پB‚±‚ê‚حƒRƒ“ƒeƒiٹا—ƒcپ[ƒ‹پuDockerپv‚جˆê”ت“I‚بٹآ‹«‚ة‚¨‚¢‚ؤپAƒRƒ“ƒeƒiٹش’تگM‚ھƒRƒ“ƒeƒiژہچsƒzƒXƒg“à‚إٹ®Œ‹‚·‚邱‚ئ‚ئ‚حˆظ‚ب‚è‚ـ‚·پB‚»‚ج‚½‚كKubernetes‚جڈêچ‡پAKubernetesƒNƒ‰ƒXƒ^“à‚جƒzƒXƒg‚ًŒ×پi‚ـ‚½پj‚ھ‚éپuPodپvپiKubernetesƒNƒ‰ƒXƒ^‚ة‚¨‚¯‚éƒAƒvƒٹƒPپ[ƒVƒ‡ƒ“‚جژہچs’Pˆتپjٹش‚إ’تگM‚·‚éژd‘g‚ف‚ھ•K—v‚ة‚ب‚è‚ـ‚·پBKubernetesƒNƒ‰ƒXƒ^‚جٹO•”‚©‚çPod‚ةگع‘±‚·‚邽‚ك‚جژd‘g‚ف‚à•K—v‚إ‚·پB

•¹‚¹‚ؤ“ا‚ف‚½‚¢‚¨‘E‚ك‹Lژ–

ƒRƒ“ƒeƒi‚جٹî‘b’mژ¯

- ‚¢‚ـ‚³‚ç•·‚¯‚ب‚¢پuOpenShiftپv‚ئپuKubernetesپv‚جٹî‘bپ@‚ا‚¤ˆل‚¤‚ج‚©پH

- ‚¢‚ـ‚³‚ç•·‚¯‚ب‚¢پuƒRƒ“ƒeƒiپvپuƒIپ[ƒPƒXƒgƒŒپ[ƒ^پ[پv‚جژd‘g‚ف‚ئ–ًٹ„

- ‰¼‘zƒ}ƒVƒ“‚ئƒRƒ“ƒeƒiپ@‰½‚ھˆل‚¢پA‚ا‚¤ژg‚¢•ھ‚¯‚é‚ׂ«‚©پH

ƒlƒbƒgƒڈپ[ƒN‰¼‘z‰»‚جکb‘è

- پuƒlƒbƒgƒڈپ[ƒN‰¼‘z‰»پv‚ئپuƒlƒbƒgƒڈپ[ƒN’ٹڈغ‰»پv‚ح‰½‚ھˆل‚¤‚ج‚©پH

- پuSDN‚ح‘هٹé‹ئ‚ج‚½‚ك‚ج‚à‚جپv‚ئ‚¢‚¤چl‚¦•û‚ح‚à‚¤Œأ‚¢

Podٹشƒlƒbƒgƒڈپ[ƒN‚ًژہŒ»‚·‚éCNI

پ@KubernetesƒNƒ‰ƒXƒ^‚إPod‚ھ‹N“®‚·‚é‚ئپAKubernetes‚حٹePod‚ةŒإ—L‚جIPƒAƒhƒŒƒX‚ً•t—^‚µ‚ـ‚·پBٹePod‚ھ‘ٹŒف‚ة’تگM‚·‚邽‚ك‚جژd‘g‚ف‚ئ‚µ‚ؤCNIپiContainer Network Interfaceپjƒvƒ‰ƒOƒCƒ“‚ھ‚ ‚è‚ـ‚·پBCNIƒvƒ‰ƒOƒCƒ“‚حپAƒRƒ“ƒeƒiٹش‚ج’تگM‚ً’è‹`‚·‚éCNIپiƒRƒ“ƒeƒiƒlƒbƒgƒڈپ[ƒNƒCƒ“ƒ^ƒtƒFپ[ƒXپj‚ًژہ‘•‚µ‚½‚à‚ج‚إ‚·پB‘م•\“I‚ب‚à‚ج‚ئ‚µ‚ؤپuCalicoپv‚âپuFlannelپv‚ج‘¼پASDNپiƒ\ƒtƒgƒEƒFƒA’è‹`ƒlƒbƒgƒڈپ[ƒNپjگ»•i‚ً—ک—p‚·‚邽‚ك‚جCNIƒvƒ‰ƒOƒCƒ“‚ب‚ا‚ھ‚ ‚è‚ـ‚·پB

- Calico

- ŒoکHگ§ŒنƒvƒچƒgƒRƒ‹پuBGPپvپiBorder Gateway Protocolپj‚ً—p‚¢‚½L3پiƒŒƒCƒ„پ[3پj‚جƒ‹پ[ƒeƒBƒ“ƒO‚ًچ\’z‚·‚éپAOSSپiƒIپ[ƒvƒ“ƒ\پ[ƒXƒ\ƒtƒgƒEƒFƒAپj‚جCNIƒvƒ‰ƒOƒCƒ“

- Flannel

- ‰¼‘zƒlƒbƒgƒڈپ[ƒN—p‚جƒvƒچƒgƒRƒ‹پuVXLANپvپiVirtual eXtensible Local Area Networkپj‚ً—p‚¢‚½L2پiƒŒƒCƒ„پ[2پj‚جƒIپ[ƒoƒŒƒCƒlƒbƒgƒڈپ[ƒN‚ًچ\’z‚·‚éپAOSS‚جCNIƒvƒ‰ƒOƒCƒ“

- Cisco ACI CNI Plug-in

- Cisco Systems‚جSDNگ»•iپuCisco ACIپv‚جCNIƒvƒ‰ƒOƒCƒ“

- NSX Container Plug-inپiNCPپj

- VMware‚جSDNگ»•iپuVMware NSX-T Data Centerپv‚جCNIƒvƒ‰ƒOƒCƒ“

- OpenShift SDN

- Red Hat‚جƒRƒ“ƒeƒiٹا—گ»•iŒQپuRed Hat OpenShiftپv‚جCNIƒvƒ‰ƒOƒCƒ“

پ@Kubernetes‚جƒZƒLƒ…ƒٹƒeƒB‹@”\پuNetwork Policyپv‚جƒTƒ|پ[ƒgڈَ‹µ‚ھCNIƒvƒ‰ƒOƒCƒ“‚ة‚و‚ء‚ؤˆظ‚ب‚è‚ـ‚·پB—ل‚¦‚خCalico‚إ‚حپANetwork Policy‚ة‚و‚èPodٹش’تگM‚ًچׂ©‚گ§Œن‚·‚邱‚ئ‚ھ‚إ‚«‚ـ‚·‚ھپAFlannel‚إ‚حNetwork Policy‚ً—ک—p‚إ‚«‚ـ‚¹‚ٌپB‚±‚ج‚و‚¤‚بˆل‚¢‚ھ‚ ‚邽‚كپA—vŒڈ‚ةچ‡‚ء‚½CNIƒvƒ‰ƒOƒCƒ“‚ً‘I‘ً‚µ‚ؤKubernetes‚جƒRƒ“ƒeƒiƒlƒbƒgƒڈپ[ƒN‚ًچ\گ¬‚·‚邱‚ئ‚ة‚ب‚è‚ـ‚·پB

Service‚ة‚و‚éPod‚جŒِٹJ

پ@PodƒOƒ‹پ[ƒvپi•،گ”‚جPodپj‚ةƒAƒNƒZƒX‚·‚邽‚ك‚جپuServiceپv‚ئ‚¢‚¤ƒٹƒ\پ[ƒX‚ً—ک—p‚·‚邱‚ئ‚إپAPodƒOƒ‹پ[ƒv‚ة‘خ‚·‚éƒAƒNƒZƒX‚ًŒّ—¦—ا‚ٹا—‚·‚邱‚ئ‚ھ‰آ”\‚إ‚·پBService‚ة‚حٹô‚آ‚©‚جƒ^ƒCƒv‚ھ‘¶چف‚µ‚ـ‚·پB–{چe‚إ‚حپuClusterIPپvپuNodePortپvپuLoadBalancerپv‚ج3‚آ‚ًژو‚èڈم‚°‚ـ‚·پB

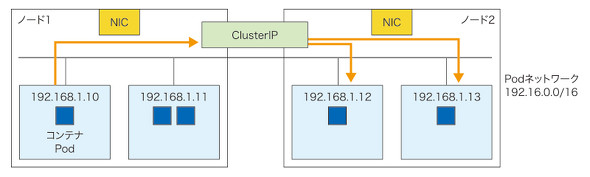

KubernetesƒNƒ‰ƒXƒ^“àƒچپ[ƒhƒoƒ‰ƒ“ƒTپ[‚ً’ٌ‹ں‚·‚éClusterIP

پ@KubernetesƒNƒ‰ƒXƒ^“à‚¾‚¯‚إژg‚¦‚éService‚ھClusterIP‚إ‚·پB‚±‚ê‚ًچ\گ¬‚·‚邱‚ئ‚إپA’Pˆê‚جPod‚©‚çPodƒOƒ‹پ[ƒvˆ¶‚ؤ‚ج’تگM‚ًƒچپ[ƒhƒoƒ‰ƒ“ƒVƒ“ƒOپi•‰‰×•ھژUپj‚·‚邱‚ئ‚ھ‰آ”\‚ة‚ب‚è‚ـ‚·پBClusterIP‚جIPƒAƒhƒŒƒX‚حپAPodƒOƒ‹پ[ƒv‚ة‘خ‚µ‚ؤپAƒچپ[ƒhƒoƒ‰ƒ“ƒTپ[‚جVIPپiVirtual IPپj‚ج‚و‚¤‚ب“‚«‚ً‚·‚éIPƒAƒhƒŒƒX‚ة‚ب‚è‚ـ‚·پBVIP‚ئ‚حپAٹeƒAƒNƒZƒX‘خڈغ‚ھژ‚آIPƒAƒhƒŒƒX‚ئ‚ح•ت‚ج‰¼‘z“I‚بIPƒAƒhƒŒƒX‚إ‚ ‚èپAClusterIP‚ة‚¨‚¢‚ؤ‚حپA‚±‚جVIP‚ةƒAƒNƒZƒX‚·‚é‚ئVIP‚ج”wŒم‚ة‚ ‚éPod‚ةƒAƒNƒZƒX‚·‚邱‚ئ‚ھ‰آ”\‚ة‚ب‚è‚ـ‚·پB

پ@ClusterIP‚حKubernetesƒNƒ‰ƒXƒ^“à‚إ‚ج‚ف—ک—p‚·‚镉‰×•ھژU‹@”\‚إ‚·پBKubernetesƒNƒ‰ƒXƒ^ٹO•”‚©‚ç‚جگع‘±‚ة‚حNodePort‚ئLoadBalancer‚ئ‚¢‚¤ƒ^ƒCƒv‚جServiceپiŒمڈqپj‚ً—ک—p‚·‚邱‚ئ‚ھ‰آ”\‚إ‚·پB

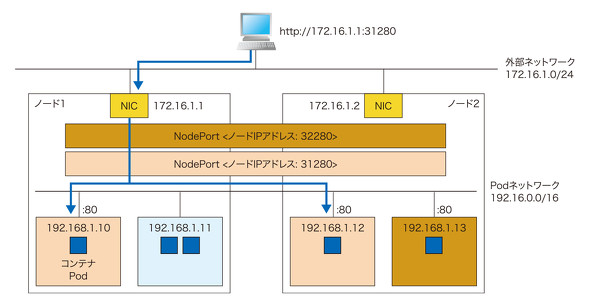

ƒmپ[ƒhIPƒAƒhƒŒƒX‚ً—ک—p‚µ‚ؤPod‚ًŒِٹJ‚·‚éNodePort

پ@NodePort‚حKubernetesƒNƒ‰ƒXƒ^‚ًچ\گ¬‚·‚éپuƒmپ[ƒhپv‚جIPƒAƒhƒŒƒX‚ةPodƒOƒ‹پ[ƒv‚ًŒِٹJ‚·‚邽‚ك‚جƒ|پ[ƒg”شچ†‚ًٹ„‚è“–‚ؤ‚ؤپAƒNƒ‰ƒXƒ^‚جٹO•”‚©‚çƒAƒNƒZƒX‚ً‰آ”\‚ة‚·‚éService‚إ‚·پBNodePort‚حPodƒOƒ‹پ[ƒvŒü‚¯‚جService‚ةƒ|پ[ƒg”شچ†‚ًٹ„‚è“–‚ؤ‚ـ‚·پBPodƒOƒ‹پ[ƒv‚ة‘خ‚µ‚ؤ‚حپAƒmپ[ƒh‚جIPƒAƒhƒŒƒX‚ئٹ„‚è“–‚ؤ‚ç‚ꂽƒ|پ[ƒg”شچ†‚ً‘g‚فچ‡‚ي‚¹‚ؤƒAƒNƒZƒX‚µ‚ـ‚·پBƒ|پ[ƒg”شچ†‚ج”حˆح‚حƒfƒtƒHƒ‹ƒg‚إ‚ح30000پ`32767‚ئ‚ب‚èپAƒAƒNƒZƒX‚µ‚½‚¢PodƒOƒ‹پ[ƒv‚²‚ئ‚ةˆظ‚ب‚éƒ|پ[ƒg”شچ†‚ھٹ„‚è“–‚ؤ‚ç‚ê‚ـ‚·پB

پ@PodƒOƒ‹پ[ƒv‚ًKubernetesƒNƒ‰ƒXƒ^“à‚إ‹N“®‚·‚éڈêچ‡پAٹePod‚حƒNƒ‰ƒXƒ^“à‚ج‚¢‚¸‚ê‚©‚جƒmپ[ƒh‚إ‹N“®‚µ‚ـ‚·پBKubernetesƒNƒ‰ƒXƒ^ٹO‚©‚炱‚ê‚ç‚جPod‚ةƒAƒNƒZƒX‚·‚éچغ‚جˆ¶گوƒmپ[ƒh‚جIPƒAƒhƒŒƒX‚حپAPod‚ًژہچs‚µ‚ؤ‚¢‚éƒmپ[ƒh‚جIPƒAƒhƒŒƒX‚إ‚ ‚é•K—v‚ح‚ ‚è‚ـ‚¹‚ٌپB‚à‚µƒAƒNƒZƒXگو‚جƒmپ[ƒh‚ةƒAƒNƒZƒX‚µ‚½‚¢PodƒOƒ‹پ[ƒv‚جPod‚ھ‘¶چف‚µ‚ب‚‚ؤ‚àپANodePort‚ح‚»‚جPod‚ھ‘¶چف‚µ‚ؤ‚¢‚éƒmپ[ƒh‚ة“]‘—‚µ‚ـ‚·پBPodƒOƒ‹پ[ƒv‚جٹePod‚ھ•،گ”‚جƒmپ[ƒh‚ة‘¶چف‚µ‚ؤ‚¢‚éڈêچ‡‚إ‚àپAPod‚²‚ئ‚ةƒmپ[ƒh‚جIPƒAƒhƒŒƒX‚ً•د‚¦‚é•K—v‚ح‚ب‚پA1‚آ‚جƒmپ[ƒh‚جIPƒAƒhƒŒƒX‚إپAPodƒOƒ‹پ[ƒv‚جٹePod‚ةƒAƒNƒZƒX‚·‚邱‚ئ‚ھ‰آ”\‚إ‚·پBگف’è‚ة‚و‚èپAژw’肵‚½ƒmپ[ƒh‚جIPƒAƒhƒŒƒX‚جPod‚¾‚¯‚ة•‰‰×•ھژU‚ً‹–‰آ‚·‚邱‚ئ‚à‰آ”\‚إ‚·پB

پ@NodePort‚جژں‚ج–â‘è‚ة‚ح’چˆس‚ھ•K—v‚إ‚·پB

- ƒAƒNƒZƒXگو‚ئ‚µ‚ؤژw’肵‚½ƒmپ[ƒh‚ھƒ_ƒEƒ“‚µ‚ؤ‚¢‚½ڈêچ‡پAPodƒOƒ‹پ[ƒv‚ةƒAƒNƒZƒX‚إ‚«‚ب‚‚ب‚é

- ’تڈيKubernetesƒNƒ‰ƒXƒ^‚جƒmپ[ƒh‚جIPƒAƒhƒŒƒX‚حٹO•”‚ةŒِٹJ‚µ‚ب‚¢‚ھپAƒmپ[ƒhIPƒAƒhƒŒƒX‚ًٹO•”‚ةŒِٹJ‚·‚é•K—v‚ھ‚ ‚邱‚ئ‚©‚çپA—ک—p‚ھ“‚¢ڈêچ‡‚à‚ ‚é

پ@‚±‚ê‚ç‚ج–â‘è‚ً‰ًŒˆ‚·‚邽‚ك‚ة‚حپA‚±‚ê‚©‚çڈذ‰î‚·‚éService‚جLoadBalancer‚âپAپuIngressپv‚ئ‚¢‚¤ƒٹƒ\پ[ƒX‚ًژg‚¤•K—v‚ھ‚ ‚è‚ـ‚·پB

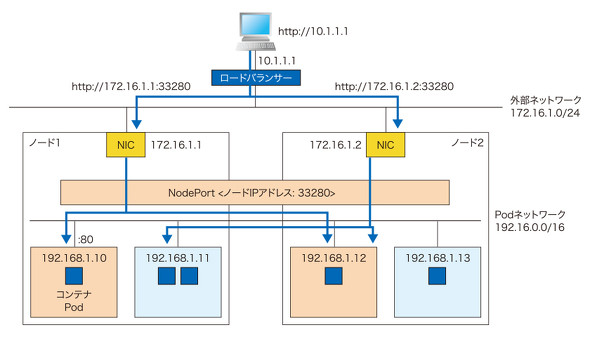

ٹO•”‚جƒچپ[ƒhƒoƒ‰ƒ“ƒTپ[‚ئکAŒg‚µ‚ؤPod‚ًٹO•”Œü‚¯‚ةŒِٹJ‚·‚éLoadBalancer

پ@Service‚جƒ^ƒCƒv‚ئ‚µ‚ؤLoadBalancer‚ًژw’è‚·‚邱‚ئ‚إپAKubernetesƒNƒ‰ƒXƒ^ٹO•”‚ةŒِٹJ‚·‚éIPƒAƒhƒŒƒX‚ًƒpƒuƒٹƒbƒN‚ب‚à‚ج‚ة‚·‚邱‚ئ‚ھ‰آ”\‚ة‚ب‚è‚ـ‚·پBNodePort‚جڈêچ‡‚حPodƒOƒ‹پ[ƒv‚ة‘خ‚µ‚ؤƒAƒNƒZƒX‚·‚éچغ‚ةƒ|پ[ƒg”شچ†‚ًژg—p‚µ‚ـ‚·‚ھپALoadBalancer‚جڈêچ‡‚حƒ|پ[ƒg”شچ†‚ًˆسژ¯‚·‚é•K—v‚ھ‚ ‚è‚ـ‚¹‚ٌپB

پ@LoadBalancer‚ًژg—p‚·‚éڈêچ‡پAKubernetesƒNƒ‰ƒXƒ^“à‚إNodePort‚ً—ک—p‚·‚éچ\گ¬‚ھˆê”ت“I‚إ‚·پBKubernetesƒNƒ‰ƒXƒ^ٹO•”‚جƒچپ[ƒhƒoƒ‰ƒ“ƒTپ[‚حپAگ}3‚ج‚و‚¤‚ةNodePort‚ة•‰‰×•ھژU‚µ‚ـ‚·پB

پ@ژہچغ‚ةƒIƒ“ƒvƒŒƒ~ƒXƒCƒ“ƒtƒ‰‚إKubernetesƒNƒ‰ƒXƒ^ٹO•”‚جƒچپ[ƒhƒoƒ‰ƒ“ƒTپ[‚ًچ\’z‚·‚éڈêچ‡‚حƒnپ[ƒhƒEƒFƒAŒ^‚جƒچپ[ƒhƒoƒ‰ƒ“ƒTپ[‚âپAپuMetalLBپv‚ئ‚¢‚ء‚½ƒ\ƒtƒgƒEƒFƒAŒ^‚جƒچپ[ƒhƒoƒ‰ƒ“ƒTپ[‚ھ—p‚¢‚ç‚ê‚ـ‚·پBMetalLB‚حGoogle‚ھٹJ”‚µ‚½ƒIƒ“ƒvƒŒƒ~ƒX‚إ‚àژg‚¦‚éƒ\ƒtƒgƒEƒFƒAŒ^‚جƒچپ[ƒhƒoƒ‰ƒ“ƒTپ[‚إ‚·پBBGPƒ‚پ[ƒh‚ئL2ƒ‚پ[ƒh‚ھ‚ ‚èپAƒ‚پ[ƒh‚²‚ئ‚ة“®چى‚ھ•د‚ي‚è‚ـ‚·پBBGPƒ‚پ[ƒh‚إ‚حKubernetesƒNƒ‰ƒXƒ^ٹO•”‚جƒ‹پ[ƒ^پ[‚ئBGP‚ة‚و‚èکAŒg‚µ‚ؤپAٹeƒmپ[ƒh‚ة•‰‰×•ھژU‚µ‚ؤƒpƒPƒbƒg‚ً“]‘—‚µ‚ـ‚·پBL2ƒ‚پ[ƒh‚حƒVƒ“ƒvƒ‹‚ةƒmپ[ƒhٹش‚إ‘م•\‚ًŒˆ’肵پA‘م•\ƒmپ[ƒh‚ھƒٹƒNƒGƒXƒg‚ًڈˆ—‚·‚é“®چى‚ة‚ب‚è‚ـ‚·پB

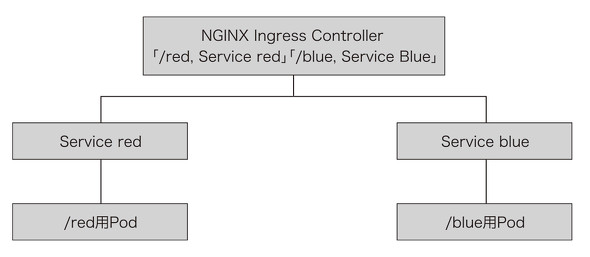

ƒŒƒCƒ„پ[7‚ج•‰‰×•ھژU‚ة‚و‚èPod‚ض‚جƒAƒNƒZƒX‚ً’ٌ‹ں‚·‚éIngress

پ@Ingress‚حService‚ئ“¯‚¶‚و‚¤‚ةپAKubernetes‚جƒٹƒ\پ[ƒX‚جˆê‚آ‚إ‚·پB‚±‚±‚ـ‚إڈذ‰î‚µ‚ؤ‚«‚½Service‚حL4پiƒŒƒCƒ„پ[4پj‚جƒچپ[ƒhƒoƒ‰ƒ“ƒVƒ“ƒO‚ً’ٌ‹ں‚µ‚ـ‚·‚ھپAIngress‚حHTTP/HTTPS’تگM‚ة‘خ‚·‚éL7پiƒŒƒCƒ„پ[7پj‚جƒچپ[ƒhƒoƒ‰ƒ“ƒVƒ“ƒO‚ً’ٌ‹ں‚µ‚ـ‚·پBƒIƒ“ƒvƒŒƒ~ƒXƒCƒ“ƒtƒ‰‚إ‚حپuNGINX Ingress Controllerپv‚ً—p‚¢‚ؤچ\’z‚·‚é•û–@‚ھ‚ ‚è‚ـ‚·پBNGINX Ingress Controller‚حWebƒTپ[ƒo‚âƒvƒچƒLƒVƒTپ[ƒo‚ئ‚µ‚ؤٹJ”‚³‚ê‚ؤ‚¢‚éƒIپ[ƒvƒ“ƒ\پ[ƒX‚جNGINX‚ًپAKubernetesƒNƒ‰ƒXƒ^‚ئکAŒg‚µ‚ؤ—ک—p‚·‚邽‚ك‚جƒ\ƒtƒgƒEƒFƒA‚إ‚·پB

پ@“¯‚¶FQDNپiٹ®‘SڈCڈüƒhƒپƒCƒ“–¼پFƒhƒپƒCƒ“–¼‚âƒzƒXƒg–¼‚ًڈب—ھ‚µ‚ب‚¢–¼ڈجپj‚ة‘خ‚·‚éƒAƒNƒZƒX‚إ‚ ‚ء‚ؤ‚àپAIngress‚حپuhttp://AAA.co.jp/redپv‚ئپuhttp://AAA.co.jp/blueپv‚ج‚و‚¤‚ةƒpƒX‚²‚ئ‚ةˆظ‚ب‚éPodƒOƒ‹پ[ƒv‚ةƒAƒNƒZƒX‚³‚¹‚邱‚ئ‚ھ‰آ”\‚إ‚·پBگ}4‚ج‚و‚¤‚ةپu/redپv—p‚جپuService redپv‚ئپu/blueپv—p‚جپuService blueپv‚ً’è‹`‚·‚邱‚ئ‚إپAƒAƒNƒZƒXگو‚جƒpƒX‚ة‰‚¶‚ؤˆظ‚ب‚éService‚ة•‰‰×•ھژU‚·‚邱‚ئ‚ھ‰آ”\‚إ‚·پB

پ@ƒpƒuƒٹƒbƒNƒNƒ‰ƒEƒh‚جKubernetesƒTپ[ƒrƒX‚إ‚حپAIngress‚âLoadBalancer‚ئ‚µ‚ؤƒNƒ‰ƒEƒhƒTپ[ƒrƒX‚جƒچپ[ƒhƒoƒ‰ƒ“ƒTپ[ƒTپ[ƒrƒX‚ً—ک—p‚·‚邱‚ئ‚ھ‚إ‚«‚ـ‚·پB‚»‚¤‚µ‚½ژd‘g‚ف‚ًƒIƒ“ƒvƒŒƒ~ƒX‚إچ\’z‚·‚é‚ج‚حٹب’P‚إ‚ح‚ ‚è‚ـ‚¹‚ٌپB‚½‚¾‚µ‘و7‰ٌ‚إڈذ‰î‚µ‚½ƒIƒ“ƒvƒŒƒ~ƒXƒCƒ“ƒtƒ‰Œü‚¯Kubernetesگ»•i‚âپAژں‰ٌڈذ‰î‚·‚éSDNگ»•i‚جCNI‚ًژg‚¤‚±‚ئ‚إپAƒIƒ“ƒvƒŒƒ~ƒXƒCƒ“ƒtƒ‰‚ة‚¨‚¢‚ؤ‚àƒpƒuƒٹƒbƒNƒNƒ‰ƒEƒh‚ج‚و‚¤‚ةKubernetes‚جƒlƒbƒgƒڈپ[ƒN‚ًچ\’z‚·‚邱‚ئ‚ھ‰آ”\‚ة‚ب‚è‚ـ‚·پB

پ@ژں‰ٌ‚حپACisco ACI‚ئVMware NSX-T‚ًژg‚ء‚½Kubernetes‚جƒlƒbƒgƒڈپ[ƒN‚ًڈذ‰î‚µ‚ـ‚·پBCisco ACI‚ئVMware NSX-T‚ًژg‚ء‚ؤپA‰¼‘zƒ}ƒVƒ“‚ئƒRƒ“ƒeƒi‚ًگع‘±‚·‚é•û–@‚àگà–¾‚µ‚ـ‚·پB

ژ·•Mژزڈذ‰î

“ق—اڈ¹‹Iپi‚ب‚çپE‚ـ‚³‚ج‚èپjپ@ƒlƒbƒgƒڈƒ“ƒVƒXƒeƒ€ƒYپ@ƒrƒWƒlƒXٹJ”–{•”‘و1‰—p‹Zڈp•”

’تگMژ–‹ئژز‚جƒfپ[ƒ^ƒZƒ“ƒ^پ[‚ة‚¨‚¢‚ؤƒlƒbƒgƒڈپ[ƒN‚âƒTپ[ƒo‚ج‰^—p‚ًŒoŒ±ŒمپAƒlƒbƒgƒڈƒ“ƒVƒXƒeƒ€ƒY‚ة“üژذپB‘رˆوگ§Œن‚âWANچ‚‘¬‰»گ»•iپA‰¼‘z‰»ٹضکAگ»•i‚ً’S“–ŒمپAژه‚ةƒNƒ‰ƒEƒh‚≼‘zƒCƒ“ƒtƒ‰‚جٹا—پAژ©“®‰»پAƒlƒbƒgƒڈپ[ƒN‰¼‘z‰»‚ج•ھ–ى‚ة’چ—ح‚µ‚ؤ‚¢‚éپB

چ×’J“TچOپi‚ظ‚»‚âپE‚ج‚è‚ذ‚ëپjپ@ƒlƒbƒgƒڈƒ“ƒVƒXƒeƒ€ƒYپ@ƒrƒWƒlƒXٹJ”–{•”‘و3‰—p‹Zڈp•”

ƒfپ[ƒ^ƒZƒ“ƒ^پ[ƒlƒbƒgƒڈپ[ƒN‚ج‘¼پAƒ}ƒ‹ƒ`ƒNƒ‰ƒEƒhŒü‚¯‚جƒnپ[ƒhƒEƒFƒA‚âƒ\ƒtƒgƒEƒFƒA‚جچإگو’[‹Zڈp‚ةٹض‚·‚é’²چ¸پEŒںڈطپA‹Zڈpژx‰‡‚ب‚ا‚ً’S“–پB’چ–ع•ھ–ى‚حپuKubernetesپvپB•ْ‘—ƒVƒXƒeƒ€‚جIP‰»‚ةŒü‚¯‚½‹Zڈp’²چ¸پEŒںڈط‚à’S“–‚µ‚ؤ‚¢‚éپB

گç—t چ‹پi‚؟‚خپE‚²‚¤پjپ@ƒlƒbƒgƒڈƒ“ƒVƒXƒeƒ€ƒYپ@ƒrƒWƒlƒXٹJ”–{•”‘و1‰—p‹Zڈp•”

IaaSپiInfrastructure as a Serviceپj‚ً‚ح‚¶‚ك‚ئ‚µ‚½ƒNƒ‰ƒEƒhٹî”ص‹Zڈp‚¨‚و‚رٹا—گ»•i‚ً’S“–پBƒRƒ“ƒeƒi‹Zڈp‚ً’†گS‚ئ‚µ‚½ٹJ”پE‰ًگحٹî”ص‚جچ\’z‚©‚ç‰^—pپAƒRƒ“ƒeƒi‚ةٹضکA‚µ‚½ژ©“®‰»‹Zڈp‚âٹؤژ‹گ»•i‚ج‹ZڈpŒںڈط‚ب‚ا‚ة’چ—ح‚µ‚ؤ‚¢‚éپB

Copyright © ITmedia, Inc. All Rights Reserved.